:昨晚凌晨一点,号称是科技界春晚的苹果发布会如期而至,此次共发布了3款iPhone手机,命名也与之前曝光的信息相符,分别为iPhone X、iPhone 8和iPhone 8 Plus。

其中iPhone X作为苹果十周年的创新性产品出现。不可否认的是,iPhone X发布之前的爆料信息都非常准确,像传闻的全面屏、取消Home键、3D面部识别扫描也都在昨晚被一一证实。

尽管没有特别让人意外的惊喜,iPhone X 的全面OLED屏、面部识别Face ID技术仍是整个发布会的亮点。

苹果iPhone X 可以说是追赶当下AI潮流的一款产品,接下来就和AI科技评论一起来详细解析Face ID的最大亮点吧,AI科技评论认为,苹果Face ID的发布,在未来将让深度摄像头成为主流。为何这么说?且听分解。

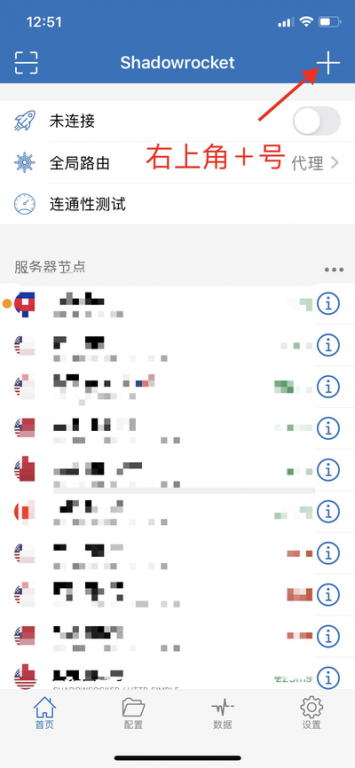

iPhone X的信息想必大家都知道了,它正面几乎全是屏幕,也就意味着唯一的按键Home键以及Touch ID的消失,而新的身份认证方式就是Face ID。如其名,在开锁时用户只需要看着手机,Face ID就能实现刷脸解锁。

随着人工智能概念的普及,人脸识别已经屡见不鲜。但这次,苹果除了用到图像识别外,还在Face ID的人脸识别中加入了深度信息,让身份认证更安全。

Face ID的实现靠的是iPhone X顶部一小块没被屏幕覆盖的区域。这一小块区域集成了多达八个组件,除了麦克风、扬声器、前置摄像头、环境光传感器、距离感应器等我们熟知的部分,还集成了红外镜头、泛光感应元件(Flood illuminator)、点阵投影器。

苹果将整个系统称之为原深感摄像头(TrueDepth Camera System),而整个系统除了能用于Face ID人脸验证,也可以扩展自拍功能,实现动画表情发布,和AR效果叠加。

具体而言,上述的感应器会投射人眼看不见的光,并读取用户的脸部3D几何结构图,并将它与存储在A11芯片隔区内的数据进行对比,如果两者一致,iPhone X就会解锁。在注册时,点阵投影仪会投射3万多个点在人脸上,从而形成一张3D人脸图,并存储在A11芯片上。

苹果甚至为此开发了一个神经引擎(Neural Engine),可即时处理人脸识别。苹果高级副总裁Phil Schiller在发布会上解释称,“我们用神经网络处理图像和点阵模式,来建立人脸数学模型。”

苹果还请好莱坞特效面具公司制作了一组面具,来训练神经网络,保证安全性。虽然下图看起来还挺可怕。

库克在发布会上说,Face ID比Touch ID更为安全,后者被破解的概率是五万分之一,而前者是百万分之一。无论是改变发型,戴上眼镜,还是戴上帽子,Face ID都能成功识别。不过苹果也提到,Face ID在长相近似的人身上可能会失效,如果是双胞胎的话,出错的概率会增加不少。

另外,Face ID还是要在用户将注意放在手机上时才能使用,也就是说解锁时要睁眼看着手机,否则就失效了。

人脸识别与刷脸支付早已被外界熟知,雷锋网也曾报道过马云在支付宝上的演示。这次苹果的Face ID在二维的图像上叠加了一层深度信息,可以保证人脸识别更安全。对于人脸识别中用照片蒙骗系统的问题,由于有了3D信息,也起不到作用。

而且正如苹果演示的那样,多出来的深度信息还可以优化前置相机拍摄效果,实现动画表情,叠加AR特效等功能。

若要追溯苹果对深度摄像头念头,不严格的说可以回到2013年。雷锋网曾报道,当年底苹果以3亿美元左右的价格收购了以色列公司PrimeSense。

PrimeSense可以说是当时最强的3D传感技术公司,它主要提供传感器和中间件,可以让设备感知周边的三维环境,实现人机交互。这家公司号称拥有全球最小的3D感知芯片,能用在手机、电视、平板、机器人等各类设备上。

它与微软合作开发了第一代体感设备Kinect。当时,微软想以体感体验与任天堂的Wii和索尼的PS争夺家庭主机市场。后来微软有意收购Primesense,但由于价格没谈拢而作罢,而且双方的合作也终止,这导致后者内部经历了大裁员。

在失去最大的客户后,Primesense估值下滑,最终被苹果收购。并购后,外界一直在猜测,苹果会何时用上深度感知技术。如今它终于将其用在了手机前置摄像头上。

目前深度感知领域有三大主流技术方案:飞行时间(TOF),结构光,双目视觉。PrimeSense用的是结构光方案,毫无疑问,苹果也用的改良版的方案。

如前所述,用结构光方案获取深度信息,原理简单来说,就是向空间投影一定图案,传感器获取反射回来的图案,与原图进行对比就能生成深度图。英特尔的RealSense实感技术也用到了这种方法。

TOF深度摄像头后来被微软用在了第二代的Kinct,其原理是,传感器发出经调制的脉冲红外光,遇物体后反射,传感器通过计算光线发射和反射时间差或相位差,来换算被拍摄景物的距离,以产生深度信息,此外再结合传统的相机拍摄,就能将物体的三维轮廓以不同颜色代表不同距离的地形图方式呈现出来。

双目视觉比较好理解,就是模仿人眼的结构,通过两个摄像头的视差来确定距离信息。这种方案在移动设备上的应用较少,多用在户外机器人。

国内做深度摄像头的厂商奥比中光告诉雷锋网,比较三种方案,飞行时间测量的精准度和稳定性较好,但结构光可以做得更小、功耗小、测量分辨率也相对高,双目则属于被动光,无法适应暗光环境。

手机后置摄像头已经从单镜头进化到了双镜头,在这次发布会前,不少业界人士就猜测,新iPhone的前置摄像头也会增加深度信息,由二维进化到三维。现在消息已经坐实,以苹果的体量无疑会引爆市场,让其它厂商纷纷跟进。只是,做指纹识别的公司美国苹果id非免税州改免税州,你们还好吗。

早在几个月之前,网上就曾传闻苹果在做AI专用芯片,用于处理AI相关任务,比如面部识别、图像处理和语音识别。如今看来指的就是这款应用在iphone X上的定制芯片A11 Bionic。发布会上苹果全球营销高级副总裁 Phil Schiller 重点介绍了“目前最强大的智能手机芯片”——A11 Bionic。该 CPU 配备六核心,2个性能核心(Mistral)和四个效能(Monson)核心,分别比 A10 快 25% 和 70%。同时由苹果自研的 GPU 处理速度也比 A10 快 30%。A11人工智能芯片,专业的Metal2图形处理软件,结合深度整合的硬件,让Face ID这样的3D交互方式成为了现实。

A11 Bionic 除了对Face ID功能的支持外,它还有助于iPhone的AR功能实现,竖排摄像头专门为 AR 而校准,刷新率可达到 60 fps,全新陀螺仪和加速计,以及准确的动作追踪,这些都离不开A11提供的强大算力。

早前,麻省理工科技评论在采访库克时,提出了苹果在AI技术领域是否落后其竞争对手的质疑。

之所以媒体不经常对苹果的AI表示肯定和赞扬,是因为苹果只喜欢谈论那些即将上线的产品功能,而不像其他一些公司喜欢给用户“画饼”。苹果不会穿越去做2019、2020、2021才做的事情,并不是苹果不知道将要做什么,而是因为不想去谈论它。

之所以媒体不经常对苹果的AI表示肯定和赞扬,是因为苹果只喜欢谈论那些即将上线的产品功能,而不像其他一些公司喜欢给用户“画饼”。苹果不会穿越去做2019、2020、2021才做的事情,并不是苹果不知道将要做什么,而是因为不想去谈论它。

同时库克举了具体已经应用到AI的例子,比如照片应用的图像识别,相册归类;Apple music的听歌推荐,通过对用户听歌记录的学习来调整作出相应的推荐。iPhone的电池续航,手机的电池管理系统使用了机器学习,了解用户的使用习惯并作出相应的调整,使续航更持久。

而在今年的7月份,经历了长达几个月外界对苹果AI技术落后的质疑后,苹果主动对外展示了AI成果,首先是在7月20日上线了苹果机器学习官方博客(Apple Machine Learning Journal),并发表了第一篇博文;其次提交的论文被CVPR 2017收录,获最佳论文。在8月份,苹果又接着在博客上发表了三篇来自Siri团队的技术文章。

从苹果公开发表的论文研究不难看出,苹果AI仍然聚焦语音识别和图像识别领域。这也是目前最成熟的两个AI应用领域。此前苹果论文获CVPR 2017最佳论文讲的就是如何提高网络生成图片的真实性,用以假乱真的图片对模型训练,从而提高图像识别的准确度。Face ID中是否也应用了CVPR最佳论文中提到的训练方法及算法呢?以及还有哪些苹果尚未对外透漏的技术?

从这次发布的新款iPhone中来看,Siri的声音的确和真人相差不大,相比前几代有很明显的提升,不知是否也用到了苹果机器学习博客中提到的Siri相关技术?

AI科技评论总结:从iPhone X的命名和读法上(读 iPhone 10)可以看出苹果的野心,要重建手机未来发展趋势(字母“X 有未来之意),iPhone X的设计至少可以两年内不过时。苹果率先使用全面屏+3D脸部识别解锁组合方式,未来一定是其他手机厂商追逐的方向,就像当初iPhone 5s引领了指纹解锁潮流一样苹果外区id作用,iPhone X是否能引领下一个十年呢?

第五届CCF大数据学术会议将于2017年10月13日-15日在深圳举行,雷锋网作为协办单位将进行全程报道。本次会议邀请到包括何友院士、Philip S. Yu、Usama Fayyad、Yi Pan、芮勇等多位知名顶级学者交流大数据研究与应用的成果和经验,共同探讨产业化所面临的关键性挑战问题和研究方向。